| 导读 | RAID有不同的级别,每个级别都有不同的用途和应用。本文介绍RAID 1的使用。使用RAID 1,数据实时镜像到另一个磁盘上。因此,这种RAID方法通常称为磁盘镜像。 |

RAID 1的主要优点是RAID中的一个磁盘出现故障,另一个磁盘将继续工作。更换故障磁盘时,新磁盘将自动同步数据。RAID 1可以添加热备盘,其中一个磁盘出现故障,自动替换。

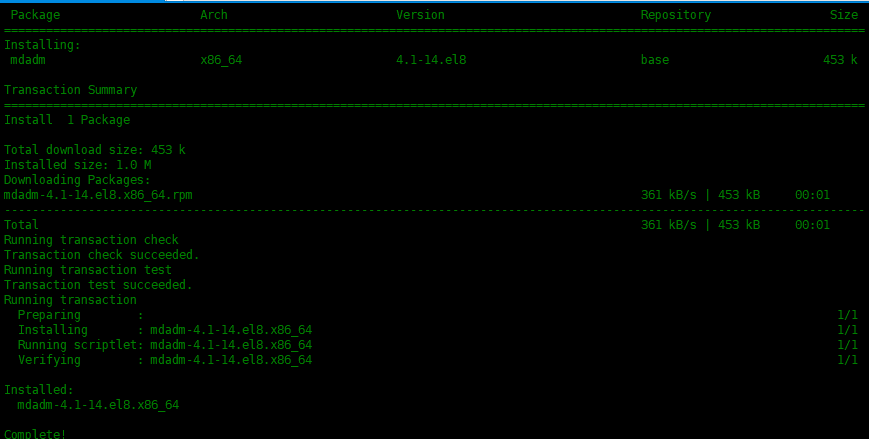

RAID磁盘:

| Device | Size |

|---|---|

| /dev/sda | 20GB |

| /dev/sdb | 20GB |

| /dev/sdc | 20GB |

| /dev/sdd | 20GB |

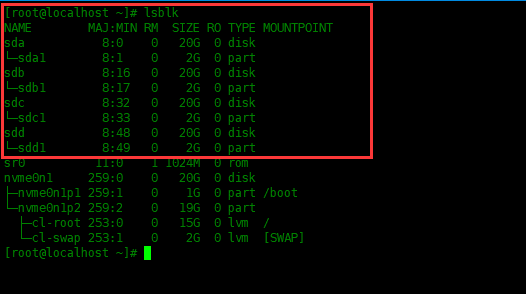

[root@localhost ~]# yum -y install mdadm

首先给/dev/sd[a-d]这四个磁盘分区,每个磁盘的第一个分区给2G的空间来做RAID 1阵列,这里就不演示分区过程了。

下面创建RAID 1:

[root@localhost ~]# mdadm --create /dev/md0 --level=1 --raid-devices=2 /dev/sda1 /dev/sdb1

上面的参数解释:

--create / -C创建一个新的阵列--level= / -l指定RAID的级别,目前支持raid0,1,4,5,6,10--raid-devices= / -n指定磁盘的数量

需要要检查RAID配置的话,请执行以下命令:

[root@localhost ~]# cat /proc/mdstat

Personalities : [raid1]

md0 : active raid1 sdb1[1] sda1[0]

2094080 blocks super 1.2 [2/2] [UU]

unused devices:

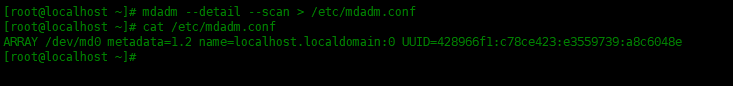

RAID配置不是永久性的,并且在计算机重新启动后会丢失。我们必须创建一个配置文件并在其中添加RAID相关信息:

[root@localhost ~]# mdadm --detail --scan > /etc/mdadm.conf

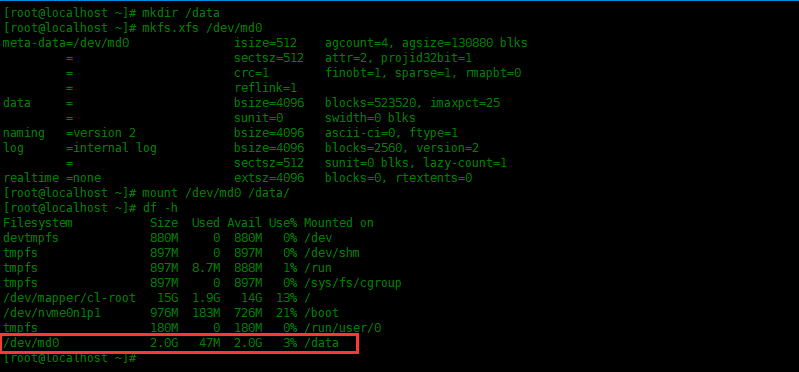

将创建好的/dev/md0设备格式化为XFS文件系统,并挂载:

[root@localhost ~]# mkdir /data

[root@localhost ~]# mkfs.xfs /dev/md0

meta-data=/dev/md0 isize=512 agcount=4, agsize=130880 blks

= sectsz=512 attr=2, projid32bit=1

= crc=1 finobt=1, sparse=1, rmapbt=0

= reflink=1

data = bsize=4096 blocks=523520, imaxpct=25

= sunit=0 swidth=0 blks

naming =version 2 bsize=4096 ascii-ci=0, ftype=1

log =internal log bsize=4096 blocks=2560, version=2

= sectsz=512 sunit=0 blks, lazy-count=1

realtime =none extsz=4096 blocks=0, rtextents=0

[root@localhost ~]# mount /dev/md0 /data/

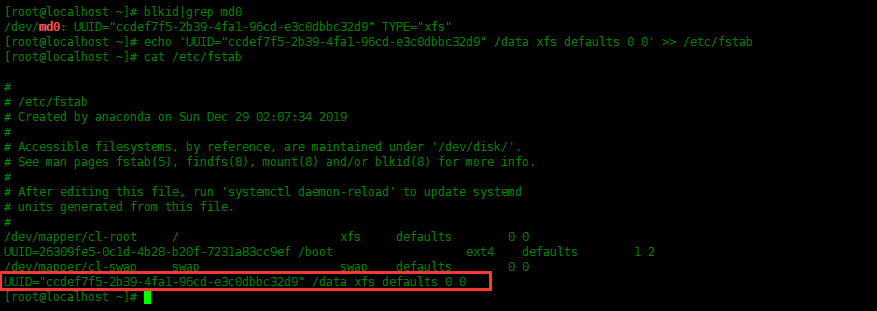

将挂载条目写入/etc/fstab使其开机自动挂载:

[root@localhost ~]# blkid|grep md0 /dev/md0: UUID="ccdef7f5-2b39-4fa1-96cd-e3c0dbbc32d9" TYPE="xfs" [root@localhost ~]# echo 'UUID="ccdef7f5-2b39-4fa1-96cd-e3c0dbbc32d9" /data xfs defaults 0 0' >> /etc/fstab

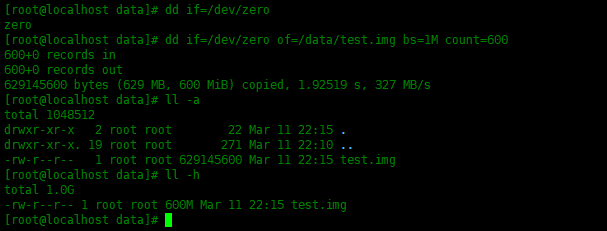

下面测试一下RAID 1阵列,在/data文件夹中写入文件测试:

[root@localhost data]# dd if=/dev/zero of=/data/test.img bs=1M count=600 600+0 records in 600+0 records out 629145600 bytes (629 MB, 600 MiB) copied, 1.92519 s, 327 MB/s

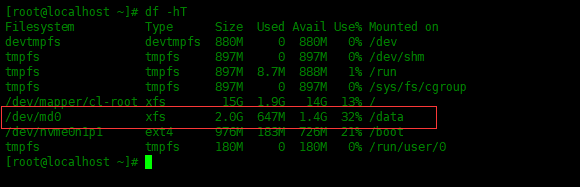

重启一下系统,检查一下RAID阵列是否自动挂载:

# reboot

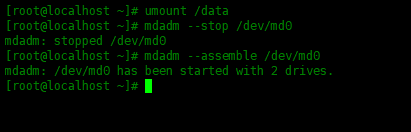

使用mdadm -S/--stop来停止阵列。使用mdadm -A/--assemble来启动阵列:

[root@localhost ~]# umount /data [root@localhost ~]# mdadm --stop /dev/md0 mdadm: stopped /dev/md0 [root@localhost ~]# mdadm --assemble /dev/md0 mdadm: /dev/md0 has been started with 2 drives.

现在,让我们在现有阵列中再添加一个磁盘/dev/sdc,使用下面命令添加到阵列里:

[root@localhost ~]# mdadm --manage /dev/md0 --add /dev/sdc1

mdadm: added /dev/sdc1

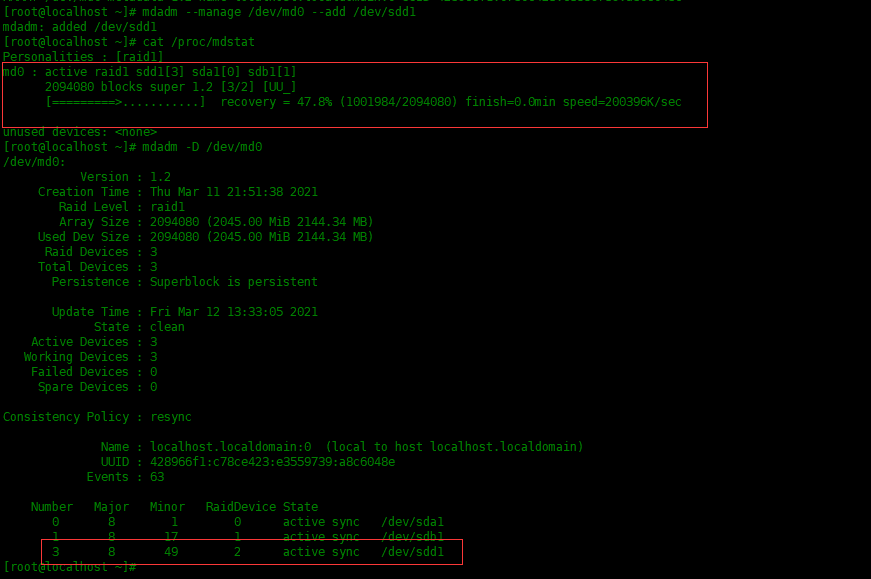

[root@localhost ~]# mdadm -D /dev/md0

/dev/md0:

Version : 1.2

Creation Time : Thu Mar 11 21:51:38 2021

Raid Level : raid1

Array Size : 2094080 (2045.00 MiB 2144.34 MB)

Used Dev Size : 2094080 (2045.00 MiB 2144.34 MB)

Raid Devices : 2

Total Devices : 3

Persistence : Superblock is persistent

Update Time : Fri Mar 12 11:28:37 2021

State : clean

Active Devices : 2

Working Devices : 3

Failed Devices : 0

Spare Devices : 1

Consistency Policy : resync

Name : localhost.localdomain:0 (local to host localhost.localdomain)

UUID : 428966f1:c78ce423:e3559739:a8c6048e

Events : 20

Number Major Minor RaidDevice State

0 8 1 0 active sync /dev/sda1

1 8 17 1 active sync /dev/sdb1

2 8 33 - spare /dev/sdc1

可以看到新添加的硬盘状态为备用盘。如果活动磁盘发生故障,该磁盘将自动变为活动磁盘。

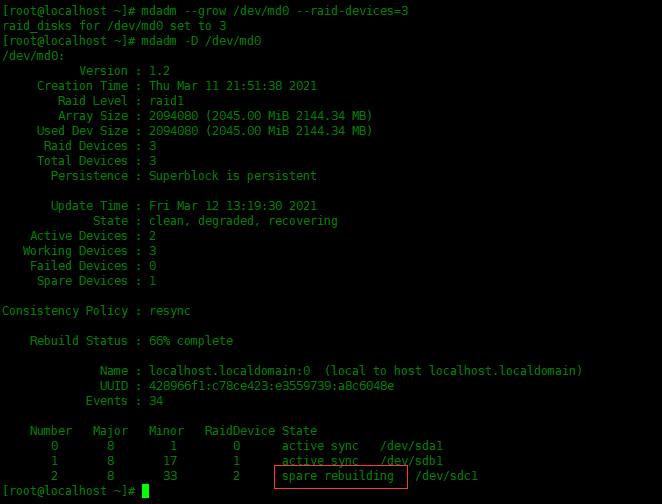

下面将RAID 1阵列里面的硬盘扩充到三个,并且三个硬盘都是活动状态,意思就是将/dev/sdc1从热备状态转换为激活状态:

[root@localhost ~]# mdadm --grow /dev/md0 --raid-devices=3 raid_disks for /dev/md0 set to 3 [root@localhost ~]# mdadm -D /dev/md0

可以看到上面两张图片中活动设备由2个变成3个。热备状态转变为活动同步状态。现在这个raid1阵列就是三个磁盘了。

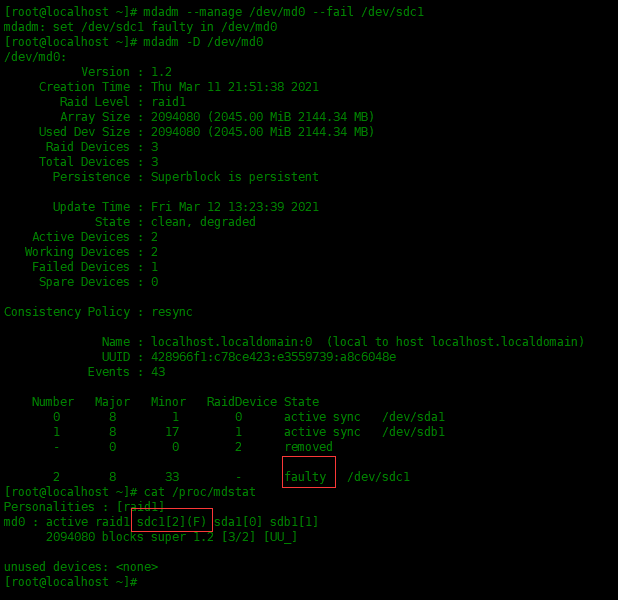

现在,磁盘阵列中有三个活动的磁盘运行在RAID 1。让我们删除磁盘/dev/sdc1并用新的/dev/sdd1磁盘替换它。下面先模拟/dev/sdc1故障状态:

[root@localhost ~]# mdadm --manage /dev/md0 --fail /dev/sdc1 mdadm: set /dev/sdc1 faulty in /dev/md0 [root@localhost ~]# mdadm -D /dev/md0

可看到/dev/sdc1已变成故障状态了。下面从md0中将/dev/sdc1移除:

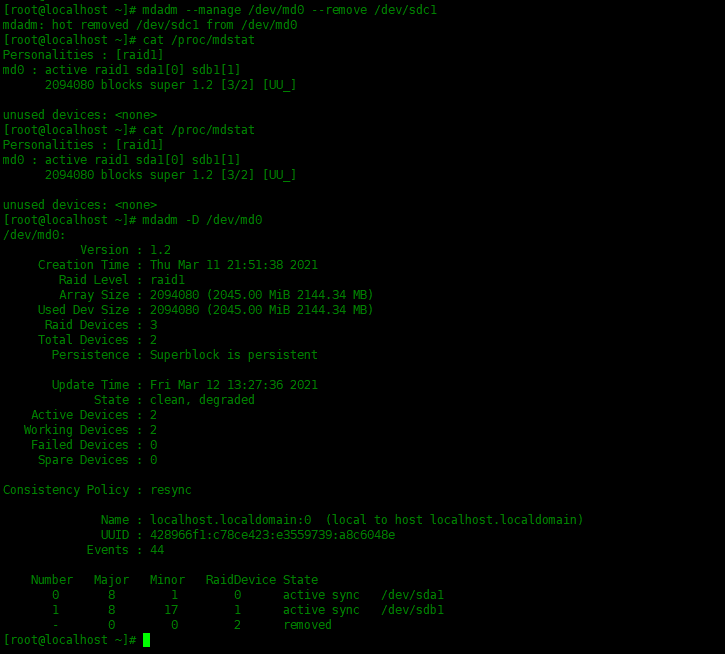

[root@localhost ~]# mdadm --manage /dev/md0 --remove /dev/sdc1 mdadm: hot removed /dev/sdc1 from /dev/md0 [root@localhost ~]# cat /proc/mdstat [root@localhost ~]# mdadm -D /dev/md0

下面将/dev/sdd1磁盘添加到该阵列中,添加完成之后一定要更新一下/etc/mdadm.conf配置文件。

[root@localhost ~]# mdadm --manage /dev/md0 --add /dev/sdd1 mdadm: added /dev/sdd1 [root@localhost ~]# cat /proc/mdstat [root@localhost ~]# mdadm -D /dev/md0 [root@localhost ~]# mdadm --detail --scan > /etc/mdadm.conf

mdadm 参数解释:

--manage管理阵列--detail / -D打印md设备的详细信息--scan / -s这个参数结合-D参数使用,获取md设备列表。--stop / -S停止一个阵列--assemble / -A激活已存在的阵列--add / -a向阵列里添加磁盘--remove / -r在阵列里删除磁盘--fail / -f模拟某个磁盘故障--grow / -G更改阵列的大小,活动磁盘数量

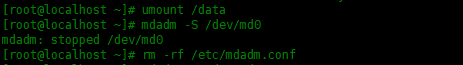

下面命令将删除RAID 1的配置:

[root@localhost ~]# umount /data [root@localhost ~]# mdadm -S /dev/md0 mdadm: stopped /dev/md0 [root@localhost ~]# rm -rf /etc/mdadm.conf

然后将/etc/fstab中的挂载条目删除掉。

下面将这四块硬盘删除raid signature签名信息,使用--zero-superblock选项将设备中包含有效的md超级块时,则使用覆盖块。

[root@localhost ~]# mdadm --zero-superblock /dev/sd[a-d]1

本实验使用RAID 1来做实验。大家可以尝试配置RAID5和RAID10。

本文原创地址:https://www.linuxprobe.com/centos8-raid-array.html编辑:逄增宝,审核员:逄增宝